L’IA dans la vidéoprotection : une rupture… sous contrainte

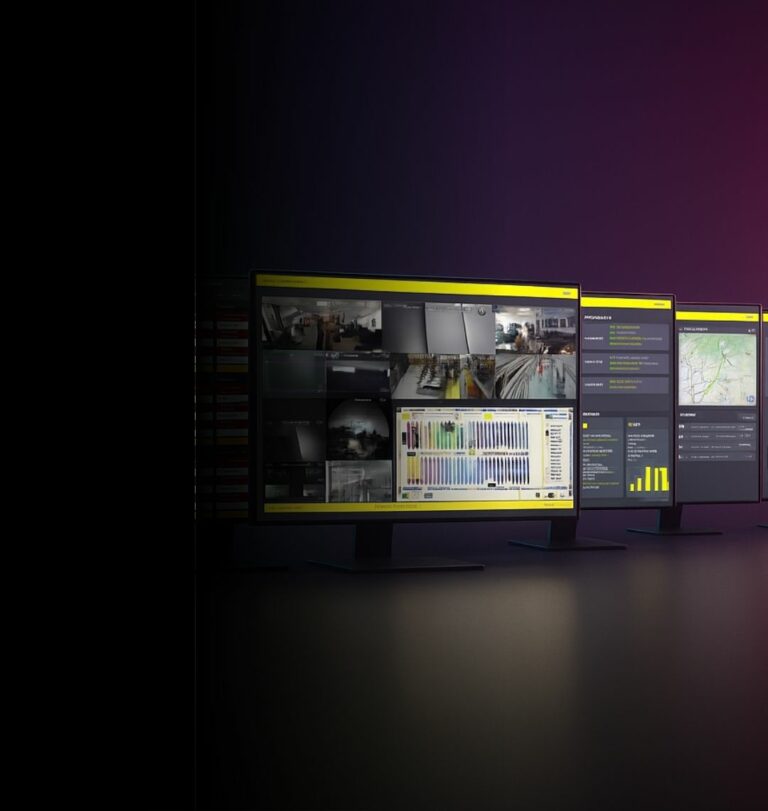

La vidéoprotection n’est plus un simple outil d’observation. Avec l’intelligence artificielle, elle devient un système capable d’interpréter, analyser et anticiper des situations en temps réel.

Cette évolution change profondément la nature du dispositif : on ne capte plus seulement des images, on traite des données, souvent personnelles, parfois sensibles. Les caméras dites “augmentées” ajoutent en effet une couche d’analyse algorithmique permettant de détecter des comportements, des objets ou des événements en temps réel.

Ce basculement technologique entraîne un basculement juridique.

Un cadre juridique plus complexe qu’il n’y paraît

Le cadre légal de la vidéoprotection intelligente repose sur un empilement de réglementations. C’est souvent là que les entreprises sous-estiment le sujet.

D’abord, il existe un socle historique issu du droit de la vidéoprotection. Il encadre l’installation des caméras, leurs finalités et les conditions d’exploitation. Mais ce cadre a été conçu pour filmer — pas pour analyser.

Ensuite, dès qu’un traitement automatisé intervient, on bascule dans le RGPD. Toute analyse d’image devient potentiellement un traitement de données personnelles, ce qui impose des exigences fortes en matière de finalité, de proportionnalité et de transparence.

Enfin, certains usages — notamment biométriques — relèvent de régimes encore plus stricts, voire interdits par principe.

En réalité, il n’existe pas “un” cadre, mais plusieurs cadres qui coexistent.

Une réalité juridique clé : un cadre… sans cadre

C’est ici que l’argument exposé lors de votre séminaire prend toute sa valeur.

Aujourd’hui, la vidéoprotection intelligente ne dispose pas d’un cadre juridique autonome. Elle se situe à l’intersection de plusieurs régimes existants qui n’ont pas été conçus pour ces usages.

La CNIL le reconnaît explicitement :

le cadre actuel de la vidéoprotection n’est pas adapté à ces nouvelles technologies, mais il ne les interdit pas non plus.

On est donc dans une zone intermédiaire :

- les dispositifs sont autorisés

- mais leur encadrement repose sur l’interprétation de plusieurs textes

- souvent inadaptés aux capacités réelles de l’IA

Cette situation crée une zone grise réglementaire structurante.

L’IA fait basculer la vidéoprotection dans une zone sensible

Ce flou juridique n’est pas anodin. Il s’explique par la nature même des technologies utilisées.

Contrairement à une caméra classique, une caméra intelligente ne se contente pas de filmer. Elle analyse les comportements, ce qui augmente considérablement les risques pour les libertés individuelles.

La CNIL alerte d’ailleurs sur le risque de “surveillance généralisée” lié à ces dispositifs, en particulier lorsqu’ils sont utilisés dans des espaces ouverts au public.

Plus la technologie est performante, plus l’exigence juridique est forte.

Une réglementation en construction (et instable)

Autre point essentiel : le cadre juridique de la vidéoprotection intelligente est encore en construction.

La première étape structurante a été la loi liée aux Jeux Olympiques 2024, qui a autorisé, à titre expérimental, l’usage d’algorithmes pour analyser les images en temps réel. Ce dispositif, limité dans le temps et dans ses usages, a ensuite été prolongé jusqu’en 2027 dans le cadre des Jeux d’hiver 2030, confirmant une approche progressive et prudente du législateur.

Mais cette logique d’expérimentation ne s’arrête pas là.

Plus récemment, une proposition de loi portée par le député Paul Midy vise à autoriser l’usage de la vidéosurveillance algorithmique dans les commerces, notamment pour lutter contre le vol. Adoptée en première lecture à l’Assemblée nationale, elle introduit un nouveau cas d’usage spécifique, là encore sous forme expérimentale.

Ce texte prévoit notamment :

- un usage limité à la détection d’événements prédéfinis (ex : comportements suspects liés au vol)

- une supervision humaine obligatoire

- l’interdiction des traitements biométriques (comme la reconnaissance faciale)

- une obligation de conformité au RGPD

Autrement dit, même les nouvelles lois ne créent pas un cadre global : elles ajoutent des briques.

| Lecture stratégique | Ce que cela implique pour les entreprises |

| Ce que révèlent ces évolutions est fondamental : 👉 le législateur ne crée pas encore de cadre général pour la vidéoprotection intelligente. Il procède par extensions successives, ciblées et expérimentales. Chaque texte : – ouvre un usage spécifique – dans un contexte précis – avec des limitations fortes 👉 Résultat : le droit évolue… mais de manière fragmentée. | Ce cadre mouvant crée une réalité très particulière : – les technologies existent déjà et sont utilisées – certaines sont tolérées ou encadrées partiellement – mais aucune doctrine globale ne stabilise les usages 👉 La conséquence est directe : les entreprises doivent naviguer dans un environnement juridique en évolution permanente. |